AR·VR 융합한 몰입형 XR 기술 개발…현장 체험 혁신

ETRI, 3차원 사용자 동작 분석·위치 추정 기술 적용

입력 : 2025.02.20

ETRI 연구진이 개발한 다중참여 원격몰입 XR기술을 활용해 자동차 레이싱 디오라마에서 레이싱을 시연하는 모습

한국전자통신연구원(ETRI)이 가상현실(VR)과 증강현실(AR)을 결합한 몰입형 XR(확장현실) 기술 개발에 성공했다고 밝혔다. 이번 연구를 통해 사용자의 경험을 더욱 생생하고 현실감 있게 구현할 수 있는 기술이 확보됐다.

해당 연구는 과학기술정보통신부 지원을 받아 4년간 진행됐으며, KAIST, ㈜제이투와이소프트, ㈜토즈와 공동으로 수행했다. 연구진은 ▲SCI 논문 4.5편 발표 ▲국내외 특허 출원 17건 ▲3건의 기술 이전 등의 성과를 거두었다.

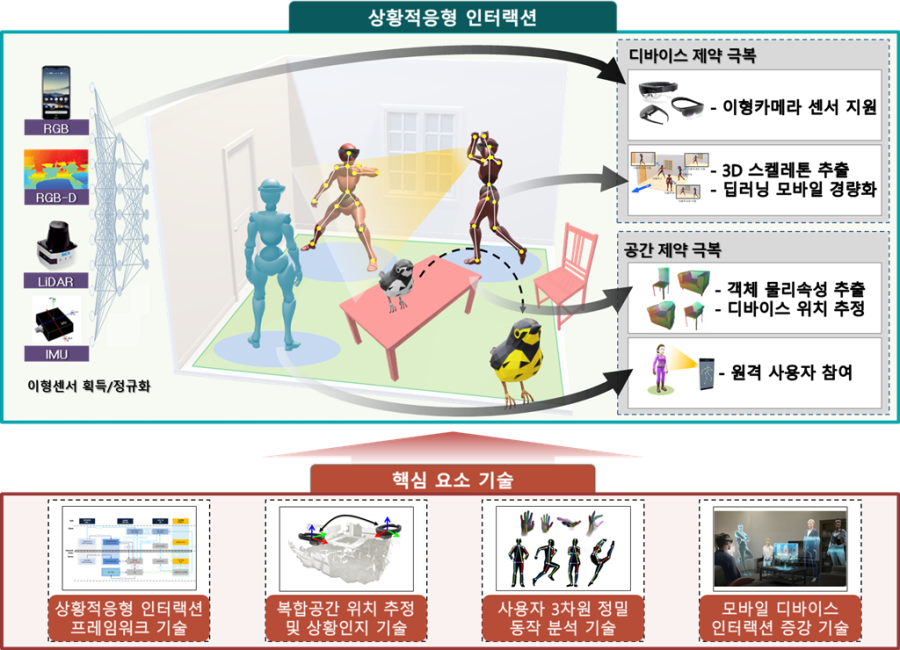

ETRI가 개발한 기술은 ▲다중·이형 센서 기반 상황 적응형 인터랙션 프레임워크 ▲다인칭 사용자 3차원 정밀 동작 분석 ▲복합공간 사용자 위치 추정 ▲개인 모바일 디바이스 인터랙션 증강 등으로 구성된다.

이 중 다인칭 사용자 3차원 정밀 동작 분석 기술과 복합공간 사용자 위치 추정 기술이 몰입형 XR 구현의 핵심으로 꼽힌다.

다인칭 사용자 3차원 정밀 동작 분석 기술은 딥러닝을 활용해 2차원 영상 데이터를 바탕으로 3차원 관절 위치 정보를 추론하는 방식이다. 기존 기술은 고가의 그래픽처리장치(GPU)를 필요로 하지만, 이번 연구에서는 스마트폰을 활용해 3차원 자세 정보를 효율적으로 추출할 수 있도록 설계됐다.

복합공간 사용자 위치 추정 기술은 AR 콘텐츠를 현실 세계와 자연스럽게 결합하는 핵심 요소다. 스마트폰 카메라로 촬영한 영상에서 특징점을 추출해 3차원 포인트 클라우드 환경 맵을 생성·보정하고, 이를 바탕으로 사용자의 디바이스 위치를 정밀하게 추정하는 방식을 적용했다.

기술개념도

이 기술을 활용하면 사용자가 별도 장비 없이도 XR 환경에서 몰입감을 극대화할 수 있으며, 다수의 사용자가 동일한 공간에서 자연스러운 인터랙션을 경험할 수 있다.

연구진은 XR 환경에서 다수의 사용자가 동시에 상호작용할 수 있는 시범 콘텐츠를 개발했다.

증강현실 속에서 스마트폰 기반 헤드마운트디스플레이(HMD)를 착용한 두 명의 로컬 사용자가 ‘여우’와 ‘어린왕자’ 역할을 맡고, 가상현실 환경에서는 원격 사용자가 HMD를 착용해 ‘허수아비’ 캐릭터를 조작하는 방식으로 몰입형 XR을 구현했다.

이 기술을 통해 사용자의 제스처를 실시간으로 인식해 가상 캐릭터에 반영하는 등 보다 직관적인 상호작용이 가능해졌다.

독일 IFA ETRI 전시 부스에서 ETRI 연구진이 다중참여 원격몰입 XR기술을 시연했다.

ETRI의 XR 기술은 노원기차마을 스키장 디오라마와 국립중앙도서관 ‘자산어보’ 체험 전시 등에서 시범 적용됐다. 또한, 2023년 9월 독일 IFA에서 다중 참여 원격 몰입형 XR 기술을 선보이며 높은 관심을 받았다.

ETRI 콘텐츠융합연구실 정성욱 책임연구원은 “과학기술정보통신부가 강조하는 연구개발(R&D) 결과물의 조기 사업화를 위해 테마파크, 국립박물관 등에서 실·가상 환경을 융합한 인터랙션 기술을 확대 적용할 계획”이라며, 향후 다양한 산업 분야로의 확산을 지원하겠다고 밝혔다.

기사 정정 / 반론

저작권자(c)산업종합저널. 무단전재-재배포금지

기사 정정 / 반론

저작권자(c)산업종합저널. 무단전재-재배포금지

관련뉴스

많이 본 뉴스

페로브스카이트 ‘대량 생산 역설’ 풀었다… 韓 연구진, 차세대 디스플레이 소부장 ‘독립’ 선언

차세대 디스플레이 시장의 ‘게임 체인저’로 불리면서도 양산의 기술적 난제에 가로막혀 있던 ‘페로브스카이트(Perovskite)’가 상용화의 임계점을 넘었다. 국내 연구진이 기존 고온 공정의 통념을 깬 ‘극저온 합성법’을 통해 품질 저하 없는 대량 생산 길을 열었기 때문이다. 이는 단순한 기

9년 집념이 뚫은 ‘물의 성배’… 영하 60℃서 액체 임계점 첫 포착

인류가 수백 년간 풀지 못한 물의 미스터리가 지난 24일 정부세종청사서 열린 합동 브리핑을 통해 세상에 공개됐다. 조종영 과학기술정보통신부 기초연구진흥과장의 소개로 시작된 발표는 김경환 포항공대 교수의 학술적 증명과 유선주 박사과정생의 현장 목소리로 이어지며 물의 근원적 비밀을 입체